A Nvidia lançou o chip Groq 3 LPU, que acelera a inferência de modelos de IA até o nível de tokens.

Nvidia revela novas funcionalidades da plataforma Vera Rubin

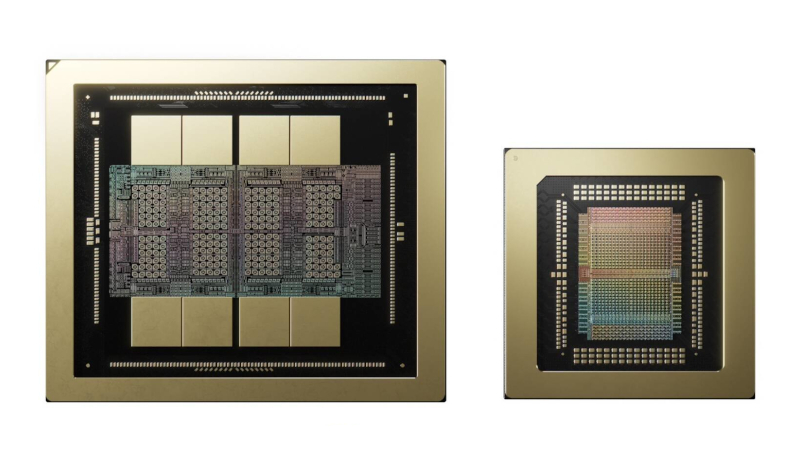

Na conferência GTC deste ano, o CEO da Nvidia, Jensen Huang, anunciou a expansão da plataforma Vera Rubin. A base das novas capacidades é a propriedade intelectual adquirida da empresa Groq, e o chip *Groq 3 LPU* – um acelerador de inferência projetado para emitir tokens com alta velocidade e baixa latência – foi incorporado ao Rubin.

O que já existe no Vera Rubin

A plataforma consiste em seis componentes-chave que a Nvidia reúne em sistemas de rack e escala para grandes fábricas de IA:

| Componente | Descrição |

|---|---|

| GPU Rubin | Placa gráfica com 288 GB HBM4 |

| CPU Vera | Processador central |

| NVLink 6 | Sistema de escalonamento intra-sistema |

| ConnectX‑9 | Adaptador de rede inteligente |

| BlueField‑4 | Processador de dados |

| Spectrum‑X | Switch de escalonamento inter-sistema com óptica integrada |

O Groq 3 LPU agora foi adicionado como um novo bloco de construção que será usado na implantação de sistemas maiores.

Por que o Groq 3 LPU se destaca

A principal diferença é a arquitetura da memória. Enquanto a maioria dos aceleradores usa HBM como memória de trabalho, cada Groq 3 LPU contém 500 MB SRAM. Comparação:

| Parâmetro | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Capacidade | 288 GB | 0,5 GB |

| Largura de banda | ~22 TB/s | até 150 TB/s |

Para tarefas de inferência sensíveis à largura de banda, a vantagem da SRAM é evidente. É por isso que a Nvidia incluiu o Groq 3 no Rubin – para aumentar a velocidade de emissão de tokens.

Rack Groq 3 LPX

O rack contém 256 chips Groq 3 LPU, proporcionando:

- 128 GB SRAM

- 40 PB/s de largura de banda total

- 640 TB/s de interface intra-sistema

O vice-presidente de soluções hiper‑escaláveis, Ian Buck, descreveu esse rack como um coprocessador para o Rubin, destacando seu papel em aumentar a performance de decodificação em cada camada do modelo e token.

Impacto nos sistemas multiagentes

Buck observou que o Groq 3 LPX será um elemento chave para o futuro mercado de IA – sistemas multiagentes. Quando os agentes trocam dados diretamente, em vez de por meio de chat‑bots, as exigências de resposta mudam: de 100 tokens/s até mais de 1 500+ tokens/s.

Concorrentes e perspectivas

O texto menciona um concorrente – Cerebras, que usa o Wafer‑Scale Engine (WSE) com enorme SRAM para inferência de baixa latência. A OpenAI já empregou a Cerebras em seus modelos avançados graças à sua latência favorável.

Buck também observou que a introdução do Groq 3 LPU pode reduzir a dependência do acelerador Rubin CPX. Enquanto a Nvidia foca na integração do rack Groq 3 LPX com a plataforma, ambos os chips têm como objetivo fortalecer a inferência sem necessidade de grandes volumes de memória GDDR7.

Conclusão:

O novo chip Groq 3 LPU e seu rack LPX reforçam o Vera Rubin no segmento de inferência de baixa latência, abrindo caminho para sistemas multiagentes de IA mais rápidos e competindo com players como a Cerebras.

Asted Cloud

Asted Cloud

Comentários (0)

Compartilhe sua opinião — por favor, seja educado e mantenha-se no tema.

Faça login para comentar