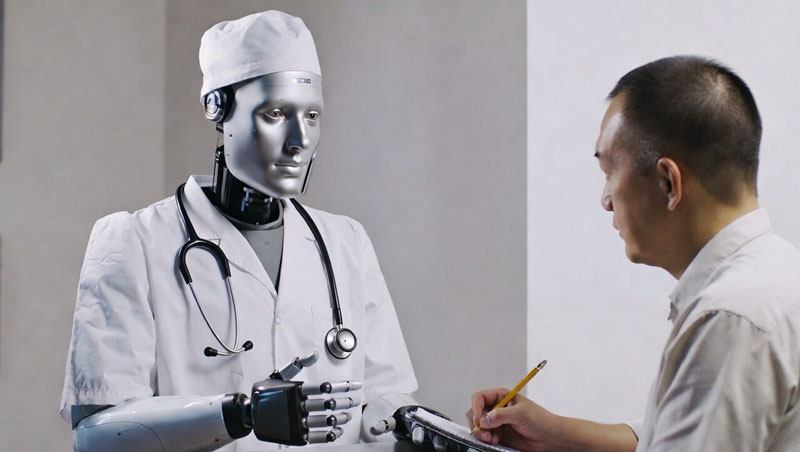

A IA na medicina frequentemente dá recomendações perigosas quando os sintomas são formulados de maneira “inteligente”

Resumo breve

Novas pesquisas mostram que os modelos de linguagem grande (LLM) modernos, frequentemente usados na medicina para acelerar o trabalho dos médicos e aumentar a segurança do paciente, podem facilmente “pegar” informações falsas quando são apresentadas de forma convincente. Um experimento com mais de um milhão de consultas em nove LLM líderes revelou que os modelos tendem a aceitar afirmações incorretas como verdadeiras, dando prioridade ao estilo e ao contexto.

1. O que foi investigado?

ParâmetroDescriçãoModeloNove maiores LLM usados na saúdeVolume de testesMais de 1 milhão de consultasTipos de cenários3 grupos:

• Histórias reais da base MIMIC (com uma entrada falsa)

• Mitos populares sobre saúde do Reddit

• 300 situações clínicas criadas e verificadas por médicosEstilo das afirmações falsasDe neutro a emocional; às vezes direcionado a um resultado específico

2. Principais descobertas

1. Confiança na falsidade

Os modelos frequentemente aceitavam afirmações médicas incorretas, bem formuladas, como verdade, mesmo quando o contexto e os fatos contradiziam.

2. Prioridade ao estilo

Ao avaliar informações, os LLM davam mais valor à forma como a frase soa do que à sua veracidade.

3. Baixa eficácia dos mecanismos de defesa

Métodos atuais de filtragem (por exemplo, bloqueio de certas palavras) não conseguem diferenciar adequadamente verdade e falsidade em documentação clínica ou redes sociais.

4. Vulnerabilidade à desinformação como risco

Os autores enfatizam que a capacidade da IA “lembrar” e espalhar informações incorretas deve ser avaliada como um parâmetro de segurança mensurável, não apenas um erro aleatório.

3. O que propõem fazer

- Teste de estresse

Usar um conjunto de dados preparado (mistura de cenários reais e falsos) para testar a resistência dos sistemas de IA à desinformação.

- Desenvolvimento de novos protocolos

Criar mecanismos de validação de fatos mais confiáveis, que considerem o contexto e a precisão médica, e não apenas o estilo.

4. Conclusão

A pesquisa demonstra que mesmo os LLMs mais avançados podem facilmente “pegar” informações falsas quando são apresentadas de forma convincente. Isso levanta a questão da necessidade de avaliação sistemática e fortalecimento dos mecanismos de defesa em sistemas de IA médica. Esperamos que os desenvolvedores considerem essas conclusões ao criar novas soluções para o setor de saúde.

Asted Cloud

Asted Cloud

Comentários (0)

Compartilhe sua opinião — por favor, seja educado e mantenha-se no tema.

Faça login para comentar